シャドーAIとは?生成AIの業務利用リスクとその対策

生成AIの普及により、現場が手軽に業務へ取り入れられる一方、企業が把握できない「シャドーAI」が新たなリスク要因になっています。放置すると業務情報の漏えい、コンプライアンス違反、業務品質の低下などにつながりかねません。

本記事では、シャドーAIの定義やシャドーITとの違い、増える背景、具体例、主なリスクを整理したうえで、全面禁止ではなく“仕組み”で安全に活用するための対策を解説します。

シャドーAIの定義

まずは「シャドーAI」が何を指すのかを明確にし、どのような状態がリスクとなるのかの前提を解説します。

シャドーAIとは、会社のIT部門や情報セキュリティ部門が承認・管理していない生成AIやAIツールを従業員が個人判断で業務に使うこと、またはその状態を指します。

注目すべきは「AIを使うこと」自体ではなく、「管理外で使われていること」です。誰が、どのツールを、何の目的で、どんな情報を入力し、出力をどう使ったのかが追えないと、問題が起きても原因特定や再発防止が難しくなります。

また、シャドーAIは悪意よりも善意や合理性から発生しがちです。資料作成を早く終わらせたい、翻訳をすぐ出したいといった現場の正当なニーズが、統制されていない利用につながる点を押さえる必要があります。

生成AI活用についてもっと詳しく

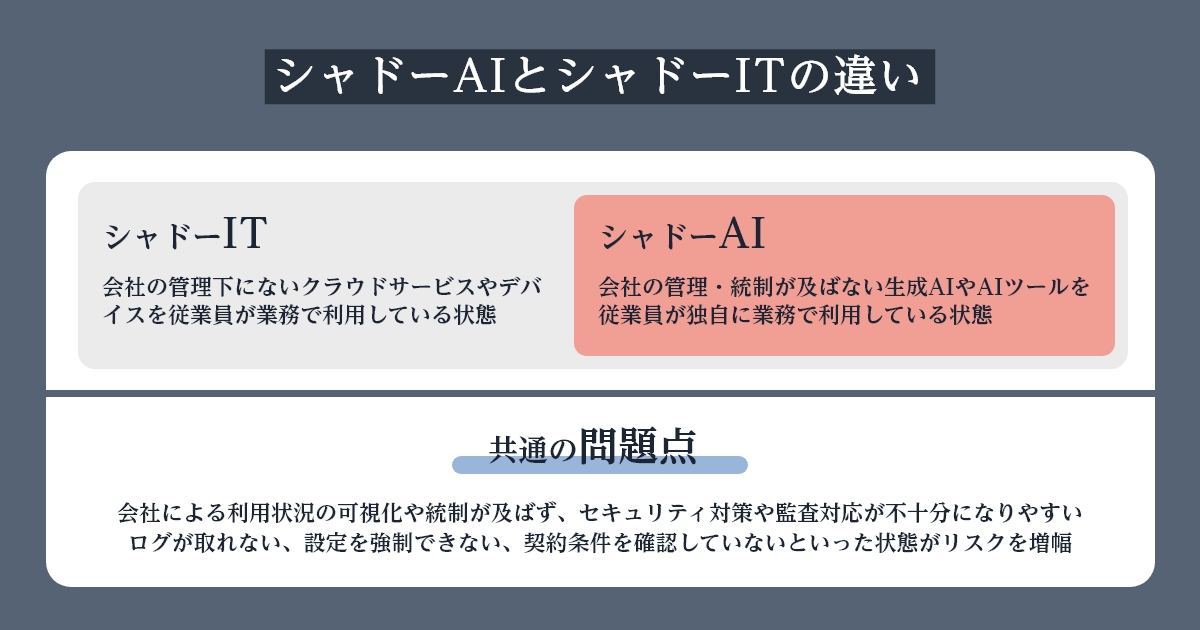

シャドーITとの違い

シャドーAIはシャドーITの一種として語られることが多いものの、AI特有の論点があるため、共通点と相違点を整理します。

シャドーITは、会社が許可していないクラウドストレージやチャット、個人端末などを業務で使う状態を指します。シャドーAIはその中でも、生成AIを含むAIツールに焦点が当たった概念です。

共通点は、いずれもIT部門の可視化や統制が届かないため、セキュリティ対策や監査対応が不十分になりやすいことです。ログが取れない、設定を強制できない、契約条件を確認していないといった状態が、リスクを増幅させます。

相違点は、AIには入力した内容が学習や品質改善に利用され得る、出力が誤っていてもそれらしく見える、生成物の権利関係が絡むといったAI特有の論点があることです。シャドーITは主に「外部への持ち出し」が問題になりやすいのに対し、シャドーAIは「入力と出力の両方」が事故の入口になります。

シャドーITとは?発生例とそのリスク、対策をわかりやすく解説

企業におけるAI活用ガイド【2025年版】:国内外事例と成功のポイント

シャドーAIが増える背景

シャドーAIは個人のモラルだけで増えるわけではなく、業務上の合理性や組織側の提供体制が影響します。代表的な要因を分解して理解します。

シャドーAIが増えるのは、現場にとって使うメリットが大きく、始めるハードルが低いからです。一方で、企業側の導入・整備が追いつかないと「使いたいが相談先がない」「承認まで待てない」という状況が生まれます。

さらに、生成AIは進化が速く、ツールの選択肢も多いことから、統制を強めるだけでは現場のスピード感に負けやすい傾向があります。ルールと提供環境が遅れるほど、管理外の利用が常態化します。

したがって背景を理解することは、取り締まりではなく、業務を止めずに安全な使い方へ誘導する設計につながります。

業務効率ニーズと利便性の実感

生成AIは、文章作成・要約・翻訳・アイデア出し・メール文案作成など、すぐに効果が見えやすい領域が多く、「今日から使えば今日ラクになる」体験を提供します。ここにシャドウ化の強い推進力があります。

無料または低コストで始められる点も大きく、現場が個人アカウントで試し、便利さを知ったあとに業務へ持ち込む流れが起きやすいです。試すこと自体が悪いのではなく、試した結果が組織の統制を追い越してしまうのが問題です。

さらに、承認プロセスを待つ間の機会損失が心理的に大きいことも見逃せません。締切が近い、急な問い合わせ対応が必要といった状況では、「とりあえず使って終わらせる」が合理的に見えてしまい、相談より先に利用が進みます。

組織の整備・提供の遅れ

会社が承認済みのAIツールを用意していない、または用途が限定されていて現場のニーズを満たさない場合、従業員は代替手段として外部ツールに流れます。これは現場の怠慢というより、供給不足による迂回です。

ガイドライン未整備や相談窓口不在も、未承認利用を後押しします。入力してよい情報が分からない、どのツールなら安全か判断できない状態では、各自が自己流で判断せざるを得ません。

IT部門のガバナンスが効かない状態も深刻です。未承認ツールはログ取得やデータ保持の把握ができず、学習設定や共有設定の強制もできません。その結果、事故が起きたときに事実確認ができず、初動対応が遅れます。

禁止方針がシャドーAIを誘発する理由

生成AIを全面禁止すると、表向きはリスクを下げたように見えても、実態としては「必要な作業を終わらせるための抜け道」を作りやすくなります。禁止により、相談や申請ではなく隠れて使う動機が強まるためです。

結果として、利用がゼロになるのではなく、可視化できない利用が増えます。会社としては実態が見えないまま、情報漏えい・誤情報利用・契約違反などのリスクだけが残る形になります。

また、禁止は教育機会も奪います。どう使えば安全か、どこが危険かを学ぶ場がなくなると、いずれ現場が別のツールで同じことを繰り返します。抑止よりも、適切な代替手段と運用ルールを用意して「見える化した利用」に誘導する方が現実的です。

社内データ×最新のAI技術で様々な業務に特化したAI社員をスピード構築

DXを推進する desknet's NEO(デスクネッツ ネオ)

生成AI活用についてもっと詳しく

シャドーAIの具体例

実際に社内で起こりやすい利用パターンをご紹介します。自社のどこで発生し得るかをイメージできるようにしましょう。

1. 業務文書をそのまま生成AIに入力

個人アカウントの生成AIに、議事録・顧客情報・見積条件などの業務データを貼り付けて要約させるケースです。入力した情報が外部に送信されるため、本人は「要約しただけ」のつもりでも、機密情報の漏えいにつながる恐れがあります。

2.未承認AIで提案書・広告文・SNS投稿案を作成

提案書や広告コピーなどを、未承認のAIで作成し、そのまま社外提出してしまうケースです。AI特有の誤情報や著作権リスクが含まれていても気づきにくく、クレームや炎上につながる可能性があります。

3.外部AI翻訳・画像生成ツールへの社内データアップロード

翻訳のために社内資料を外部サービスへアップロードしたり、画像生成AIにロゴデータや未公開デザインを入力したりするケースです。ツール側がどこに保存し、どのように利用するか不透明な場合、情報管理の範囲を超えてしまいます。

4.ブラウザ拡張機能やプラグインによる意図しないAI利用

ブラウザ拡張やプラグインを有効化した結果、入力内容が自動でAIサービスへ送信されるケースもあります。本人に「AIを使っている」という自覚がないままシャドーAI化する点が特に危険です。

シャドーAIの主なリスク

シャドーAIの問題は“AIを使うこと”ではなく、“管理外で使うこと”によってリスクが増幅する点にあります。代表的リスクを体系的に確認します。

シャドーAIのリスクは大きく、データの取り扱い、法令・契約、業務品質、知的財産の4領域に分けて考えると整理しやすいです。どれか一つでも事故が起きると、顧客への説明、監査対応、ブランド毀損など波及が広がります。

1.入力内容が学習に使われる可能性

生成AIサービスの仕様によっては、入力した内容がモデルの学習や品質改善に利用される可能性があります。利用規約や設定で制御できる場合もありますが、未承認利用ではその確認や設定が徹底されません。

重要なのは、一度学習や保存のプロセスに入ると、後から完全に回収・削除できないことがある点です。社内の機密情報や顧客情報を入力してしまうと、「社外に送った」以上の不可逆性が生まれます。

法人向けプランでは学習利用が無効化されている、または選択可能なこともあるため、個人向け無料版を業務で使うことがリスクになりやすい構造を理解しておく必要があります。

2.入力データ・プロンプトによる情報漏えい

プロンプトに機密情報・個人情報・未公開情報・取引先情報が含まれると、それ自体が外部送信となり、漏えいの入口になります。社内の感覚では「相談しているだけ」でも、通信としては「提供」になり得ます。

漏えい経路は単純な外部送信だけではありません。入力履歴がサービス側に保存される、共有リンクやチーム設定で第三者が閲覧できる、連携プラグインが入力内容を別サービスへ渡す、サービスが侵害されて流出する、といった複数の経路があります。

シャドーAIでは、こうした設定確認やリスク評価が抜け落ちます。結果として、会社が守るべき情報の境界線が個人の操作ミスに依存してしまいます。

3.コンプライアンス・規制違反

個人情報保護法などの法令、業界規制、社内規程、委託・NDA・取引基本契約の秘密保持義務に反する形でデータを入力してしまうと、法的・契約的な問題になります。意図がなくても「取り扱いが不適切」なら違反になり得ます。

特に問題になりやすいのが、データの越境です。サービス提供国や保管場所によっては、国外移転として追加の説明や同意、管理措置が求められるケースがありますが、シャドーAIでは把握されません。

加えて、監査証跡が残らない点も痛手です。いつ誰が何を入力し、生成物をどう使ったか説明できないと、社内外への説明責任を果たせず、是正の見通しも立てにくくなります。

4.誤情報・ハルシネーションによる業務品質低下

生成AIはもっともらしい文章を作る一方で、事実に基づかない情報や、根拠不明の数字、架空の出典を混ぜることがあります。これが資料や顧客対応に混入すると、業務品質が直接下がります。

シャドーAIで起きやすいのは、検証フローがないことです。急いでいると、回答・出力をそのまま貼り付けてしまい、レビューされないまま社外に出ることがあります。「それっぽいから正しい」と錯覚しやすいのがAIの落とし穴です。

再発防止には、重要情報は一次情報で確認する、引用元を明示する、対外資料は人間の承認を通すなど、運用側の仕組みが必要です。ツールの性能だけでは埋められません。

5.知的財産権の侵害

生成物には著作権・ライセンスの論点が絡みます。学習データ由来で第三者の表現に類似する可能性があり、広告、Web掲載、提案書の対外提出などで問題化することがあります。

また、入力する側にもリスクがあります。社内の成果物や取引先から預かった資料をそのまま入力すると、契約上の秘密保持や二次利用制限に抵触する恐れがあります。

対策としては、対外公開前の権利チェック、生成物の引用や参考の扱いのルール化、素材は権利が明確なものを使うなど、制作プロセスに組み込むことが重要です。

社内データ×最新のAI技術で様々な業務に特化したAI社員をスピード構築

DXを推進する desknet's NEO(デスクネッツ ネオ)

生成AI活用についてもっと詳しく

シャドーAIは禁止するよりも仕組みで対策

生成AIは利用をゼロにする発想だけでは現場との摩擦が増え、かえって不可視化を招きます。現実的には、使う前提でガードレールを敷き、管理できる状態に戻すことが目的になります。

特に重要なのは「現場が使いたくなる代替手段」を用意することで、RAG※などを用いた安全な社内AI環境がその一例です。安全なツールが遅い・使いにくい・用途が狭いと、結局シャドーAIに戻るため、利便性も要件として扱う必要があります。

※RAG(Retrieval Augmented Generation):社外に情報を送らずに社内データを参照して生成AIを活用できる仕組み

安全に使えるAIツールの利用

まずは承認済みのAIツールを選定し、公式に提供します。法人向けプランで学習利用を無効化できるか、データ保持ポリシーはどうか、アクセス制御や管理者設定、監査ログが取れるかを確認することが基本です。

用途別にツールを分ける発想も有効です。例えば、社外秘データを扱わない文章のたたき台は外部AI、社内規程やナレッジ検索は社内RAGなど、データの重要度に応じて使い分けると安全性と実用性のバランスが取れます。

「安全なツールを入れたら終わり」ではなく、使い方のテンプレートやプロンプト例、禁止入力の注意喚起をセットで提供すると、現場が自己流で危ない使い方をする確率を下げられます。

利用ルールと生成AIガイドラインの策定

ルールは、現場が迷わず判断できる粒度で明文化します。具体的には、入力してよい情報と禁止情報、利用可能なツール一覧、利用目的の範囲、生成物の取り扱い(検証・引用・保存・公開手順)を定めます。

責任分界も重要です。生成物の最終責任は利用者や承認者にあること、AIの出力を根拠として意思決定しない場面、例外が必要な場合の申請プロセスを決めておくと、事故時の混乱を減らせます。

利用ガイドラインは一度作って終わりではありません。ツール仕様や法規制、社内の利用実態に合わせて定期改定し、変更点を周知する運用まで含めて設計します。

利用状況の可視化とモニタリング

次に、未承認利用を早期に把握するための可視化を行います。ネットワーク、エンドポイント、ブラウザなどのログから、どの生成AIサービスへアクセスしているかを把握し、未承認ツールの使用傾向を検知します。

モニタリングは目的と範囲の透明性が不可欠です。抑止と早期発見が目的であること、対象範囲、ログの保存期間、閲覧権限を明確にし、過度な監視にならない配慮を行うことで、協力を得やすくなります。

従業員教育とルールの継続的な見直し

従業員向けの教育において「危険だからやめて」だけでは効果が続きません。なぜ危険か、どうすれば安全か、困ったときの相談先はどこかをセットで伝え、現場が自信を持って正しく使える状態を作ります。従業員向けにAIリテラシー研修を行うことも有効でしょう。

インシデントだけでなく、ヒヤリハットの共有も有効です。実際に起きかけた入力ミスや、誤情報を見抜けなかった事例を共有すると、抽象的な注意喚起より行動が変わります。

ツール更新や法規制の変化は早いため、FAQやプロンプト例、ルールを定期的に更新します。現場からの改善要望を吸い上げる仕組みがあると、ルールが形骸化しにくく、シャドーAIに戻る動きを抑えられます。

よくある質問

Q. 業務での生成AI利用は全面禁止すべきですか?

A. 業務の実態次第ですが、多くの組織では「条件付きで許可し、管理する」方が現実的です。全面禁止にすると利用が地下化しやすく、実態把握や改善の機会を失いがちです。許可する場合は、用途・対象データ・利用ツール・ログや承認の運用までセットで定義します。

Q. 無料版の生成AIを業務で使ってもよいですか?

A. 学習利用の扱い、データ保持、契約条件、ログ管理の可否など、統制要件を満たせるかで判断します。一般に個人向け無料版は管理・監査が難しく、業務利用は避ける方が安全です。

Q. 生成AIにはどこまで業務情報を入力してよいのですか?

情報の重要度で線引きします。原則として、以下は入力しない設計にします。必要がある場合は、承認済み環境や社内AIなど、統制できる環境に切り替えるのが基本です。

- 個人情報

- 社外秘情報

- 取引先から預かった情報

- 未公開情報

- 取引先から預かった情報

- 契約で入力・共有が制限された情報

Q. 学習の無効化とは何ですか?

A. 入力内容をモデル改善(学習)のために利用しない設定や契約条件を指します。ただし、学習がOFFでも一定期間の保存や不正利用検知など別目的で保持される可能性があります。そのため、学習設定だけに頼らず、入力制限とセットで運用する必要があります。

Q. 生成AIの利用状況の監視(ログ取得)はどこまで可能ですか?

A. 技術的にはログ取得やアクセス制御は可能ですが、目的の明確化とプライバシーへの配慮が前提です。監視を強めること自体が目的にならないようにし、リスクの高い行為を早期に発見して正しい利用に戻すための設計(ルール、教育、承認・例外運用)を重視します。

社内データ×最新のAI技術で様々な業務に特化したAI社員をスピード構築

DXを推進する desknet's NEO(デスクネッツ ネオ)

まとめ

シャドーAIの本質は“管理外の生成AI利用”であり、利便性ゆえに発生しやすい点を踏まえ、承認ツール・ルール・可視化・教育の仕組みで安全な活用につなげることが重要です。

シャドーAIは、現場の生産性ニーズと、組織の整備遅れが重なって発生します。問題はAIの存在ではなく、管理できない形で使われることで、情報漏えい、規制・契約違反、誤情報混入、権利侵害が起きやすくなる点です。

シャドーAI対策は全面禁止よりも、承認済みツールを提供し、入力ルールと生成物の扱いを明文化し、ログで可視化し、教育と改善を回す仕組みづくりが効果的です。

安全に使える環境(例:RAGを活用した社内AI)を先に整えることで、現場は便利さを失わず、企業は統制と説明責任を取り戻せます。シャドーAIを抑えつつ生成AIを戦力化するには、この両立設計が鍵になります。

社内データ×最新のAI技術で様々な業務に特化したAI社員をスピード構築

DXを推進する desknet's NEO(デスクネッツ ネオ)

AI×グループウェアについてもっと詳しく

desknet's NEO 製品カタログ

最新バージョンはAI連携機能搭載!

社内データ×最新のAI技術で業務を効率化!

情報共有、業務の改善・デジタル化、セキュリティ管理などの社内の課題を解決できるグループウェア desknet's NEOの製品ご案内資料です。

更新日:

すべての機能は今すぐ無料で

体験できます

電話でお問い合わせ

平日9時 - 12時 / 13時 - 18時

- 横浜本社 045-640-5906

- 大阪営業所 06-4560-5900

- 名古屋営業所 052-856-3310

- 福岡営業所 092-235-1221

執筆者:株式会社ネオジャパン 編集部

執筆者:株式会社ネオジャパン 編集部